深度学习中的多个损失平衡策略是确保神经网络在训练过程中能够综合考虑不同任务或目标的重要手段。这些策略包括:,,1. **等权重法**:将不同损失函数设置为相等的权重,使神经网络在训练时能够平衡对待各个任务。,2. **加权平均法**:根据任务的重要性赋予不同的权重,使神经网络能够优先考虑重要的任务。,3. **动态权重调整**:在训练过程中,根据网络的性能动态调整权重,确保网络能够持续优化。,4. **多任务学习**:将多个任务整合到一个神经网络中,通过共享底层特征提取器来平衡不同任务的需求。,,这些策略有助于解决深度学习中的多个损失平衡问题,提高神经网络的性能和泛化能力。

在深度学习中,处理多个损失函数(loss)是一个常见的挑战,当模型需要完成多个任务时,每个任务可能对应一个损失函数,这时就需要找到一种方法平衡这些损失,以确保模型在所有任务上都表现良好,以下是一些常见的多个损失平衡策略:

1、平均损失:将多个损失函数的值相加,然后取平均值,这种方法简单直观,但可能导致某些任务在模型优化中被忽视。

2、加权平均损失:根据每个任务的重要性,给每个损失函数分配一个权重,然后将加权后的损失相加,这种方法可以更好地平衡不同任务之间的损失。

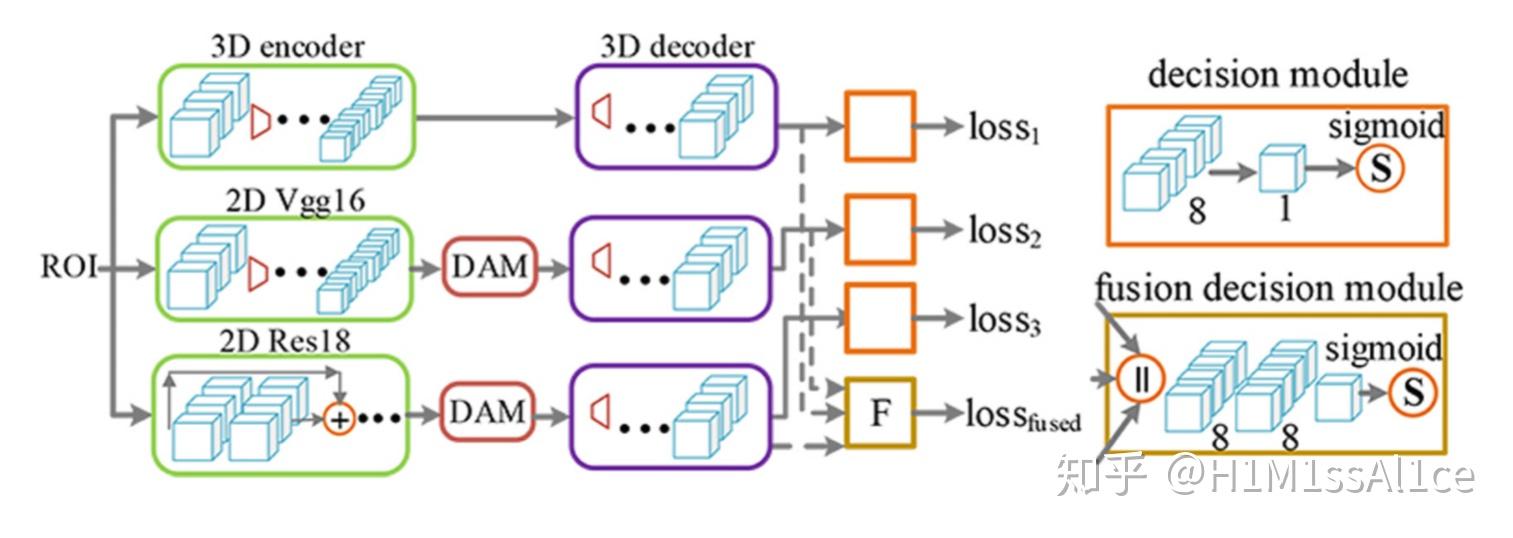

3、多任务学习:将多个任务作为一个整体进行优化,使用共享底层网络结构的方法,这种方法可以显著提高模型的效率,但需要设计良好的网络结构和优化器。

4、梯度合并:将多个损失函数的梯度进行合并,然后更新模型参数,这种方法可以确保模型在所有任务上都得到优化,但需要谨慎选择合并梯度的方法。

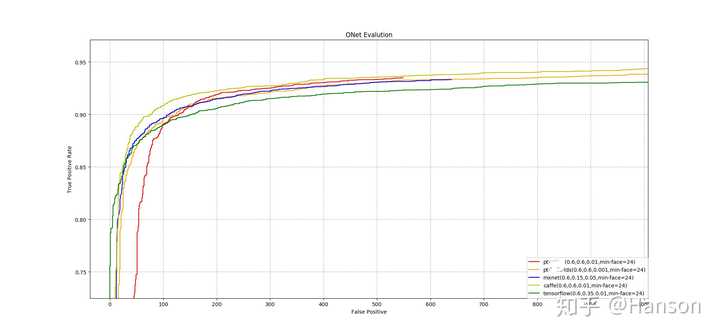

5、动态权重调整:在训练过程中,根据模型的性能动态调整每个损失函数的权重,这种方法可以适应性地优化模型,但需要设计合理的权重调整策略。

这些策略各有优劣,具体应用取决于模型的架构、任务的数量和性质等因素,下面我们将详细讨论这些策略的应用场景和优缺点。

平均损失

平均损失是一种简单直观的方法,适用于所有任务都同等重要的场景,通过将多个损失函数相加并求平均值,可以确保模型在所有任务上都得到一定的优化,这种方法可能导致某些任务在模型优化中被忽视,因为平均损失无法区分不同任务的重要性。

加权平均损失

加权平均损失通过给每个损失函数分配一个权重来改进平均损失方法,这种方法可以更好地平衡不同任务之间的损失,从而提高模型的性能,权重的选择需要谨慎考虑,不同的权重设置可能会对模型产生不同的影响。

多任务学习

多任务学习是一种将多个任务作为一个整体进行优化方法,通过共享底层网络结构,多任务学习可以显著提高模型的效率,这种方法需要设计良好的网络结构和优化器,以确保所有任务都能得到充分的优化。

梯度合并

梯度合并是一种将多个损失函数的梯度进行合并的方法,通过合并梯度,可以确保模型在所有任务上都得到优化,这种方法需要谨慎选择合并梯度的方法,以避免梯度消失或爆炸的问题。

动态权重调整

动态权重调整是一种在训练过程中动态调整每个损失函数权重的方法,这种方法可以适应性地优化模型,因为权重可以根据模型的性能进行调整,这种方法需要设计合理的权重调整策略,以确保模型的稳定性和效率。

多个损失平衡策略在深度学习中发挥着重要作用,选择适当的平衡策略取决于具体的场景和需求,在未来的工作中,我们可以进一步探索更复杂的平衡策略,以提高深度学习模型的性能和效率。

晋ICP备2023010992号-1

晋ICP备2023010992号-1